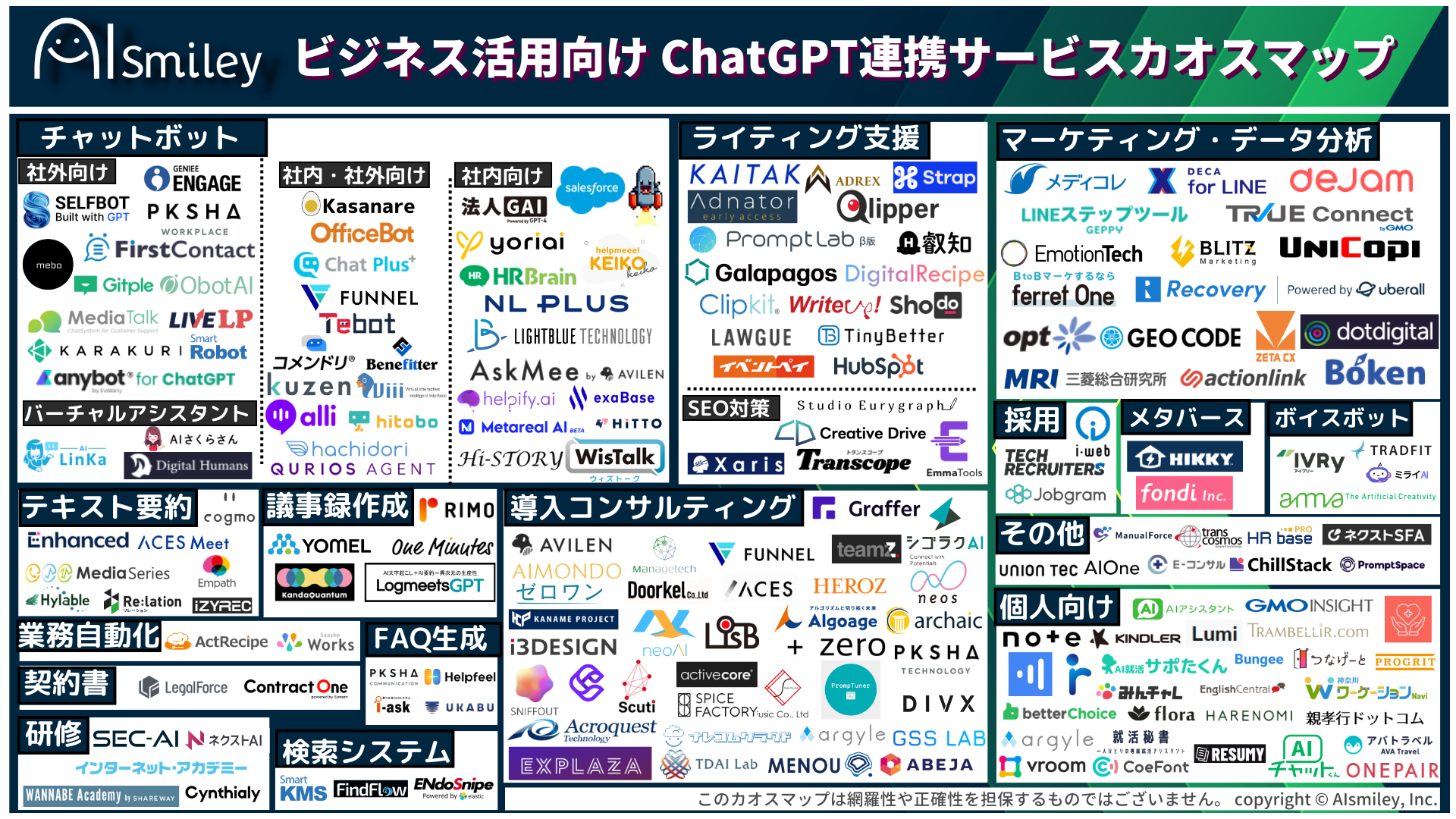

ChatGPT連携サービス

ChatGPT連携サービス

ChatGPT連携サービス

生成AI

生成AI

AI受託開発

AI受託開発

対話型AI -Conversational AI-

対話型AI -Conversational AI-

ボイスボット

ボイスボット

バーチャルヒューマン

バーチャルヒューマン

教師データ作成

教師データ作成

ナレッジマネジメントツール

ナレッジマネジメントツール

AI研究開発

AI研究開発

通訳・翻訳

通訳・翻訳

声紋認証

声紋認証

機密情報共有・管理

機密情報共有・管理

契約書管理システム

契約書管理システム

ワークステーション

ワークステーション

FAQシステム

FAQシステム

AIカメラ

AIカメラ

生体認証

生体認証

インボイス制度対応システム

インボイス制度対応システム

データセットの収集・購入

データセットの収集・購入

コールセンター

コールセンター

人事・総務向け

人事・総務向け

インバウンド対策

インバウンド対策

コンバージョンアップ

コンバージョンアップ

KYT・危険予知で労働災害防止

KYT・危険予知で労働災害防止

無料AI活用

無料AI活用

顧客リスト自動生成

顧客リスト自動生成

ロボットで自動化

ロボットで自動化

LINE連携

LINE連携

セキュリティー強化

セキュリティー強化

テレワーク導入

テレワーク導入

AI学習データ作成

AI学習データ作成

配送ルート最適化

配送ルート最適化

非接触AI

非接触AI

受付をAIで自動化、効率化

受付をAIで自動化、効率化

AIリテラシーの向上サービス

AIリテラシーの向上サービス

日本語の手書き文字対応AI-OCR

日本語の手書き文字対応AI-OCR

Windows作業の自動化RPAツール

Windows作業の自動化RPAツール

リスク分析AIで与信管理

リスク分析AIで与信管理

紙帳票仕分けAI-OCRサービス

紙帳票仕分けAI-OCRサービス

サプライチェーン

サプライチェーン

自治体向けAI

自治体向けAI

AIコンサルティング

AIコンサルティング

最終更新日:2024/02/07

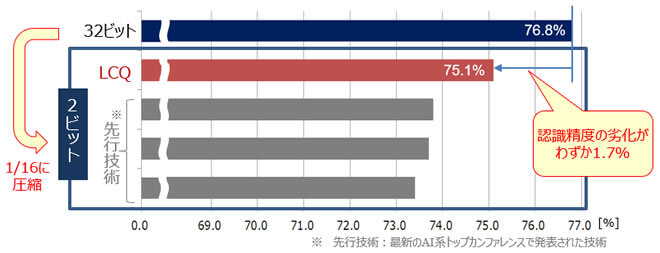

OKIと国立研究開発法人新エネルギー・産業技術総合開発機構(NEDO)は、AIの学習時に量子化値を最適に割り当てる低ビット量子化技術「LCQ」を開発しました。画像認識で高精度モデルを32ビットから2ビットへと16分の1に圧縮した場合、LCQを適用することで画像認識精度の劣化を1.7%と非常に小さく抑えることに成功しました。

このAIニュースのポイント

国立研究開発法人新エネルギー・産業技術総合開発機構(NEDO)と沖電気工業株式会社(OKI)は、「高効率・高速処理を可能とするAIチップ・次世代コンピューティングの技術開発」において、AIの学習時に量子化値を最適に割り当てる低ビット量子化技術「LCQ(Learnable Companding Quantization)」を開発しました。

LCQは、ディープニューラルネットワークの高精度モデルで、ビット数を32ビットから2ビットへと16分の1に圧縮しても画像認識精度の劣化を世界トップクラスの1.7%に抑えることに成功し、エッジ領域での演算負荷低減を実現します。

ディープニューラルネットワーク(DNN)は、画像や音声などの認識において優れた性能を発揮するAI・人工知能として注目されています。一方で、高い精度を得るためには大量の演算リソースや電力が必要なため、メモリーや電力に制限のあるエッジデバイスへの組み込みには課題がありました。

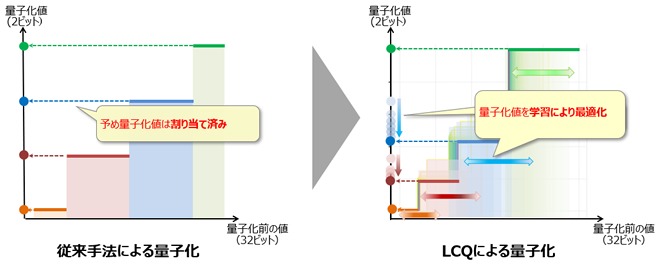

しかし、FPGA (Field-Programmable Gate Array)などの先行技術では、量子化 (圧縮) する前の値に対する量子化後の値(量子化値)をあらかじめ固定値として割り当てるため、2ビットなどの超低ビットへ圧縮すると固定値との誤差により認識精度が劣化し、実用化への障壁となっていました。

こうした背景のもと、NEDOとOKIは、「高効率・高速処理を可能とするAIチップ・次世代コンピューティングの技術開発」において、DNNの学習時に、推論時の認識精度を維持するのに最適な低ビット量子化値を割り当てることができる低ビット量子化技術「LCQ」を開発。

DNNの性能をはかる指標(ベンチマーク)とされる画像認識で高精度モデルを32ビットから2ビットへと16分の1に圧縮した場合、先行技術では認識精度に約3%の劣化が生じるのに対し、LCQを適用することでこれを1.7%と非常に小さく抑えることに成功し、世界トップクラスの認識精度を達成しました。

NEDOとOKIは音声符号化分野でよく扱われる非線形量子化技術Companding(注5)を応用したLCQにより、DNNの学習での量子化値を柔軟に割り当てることに成功しました。

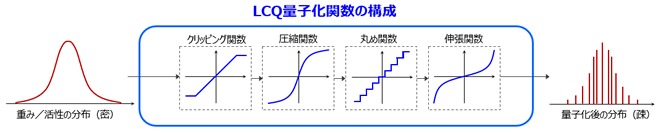

LCQではDNNの最適化させたい推論の誤差関数の傾き (誤差勾配) に基づいて、線形量子化演算の前後に通す圧縮関数と伸張関数を学習し、これを反映した量子化処理を行うことで、非線形な量子化関数が構築され、最適な量子化値を割り当てることが可能。

低ビット量子化時の課題となっていた認識精度の劣化を抑制できるだけでなく、2ビットなど超低ビット量子化で高い効果を発揮することが確認でき、演算リソースが限られるエッジデバイスへのAI搭載が可能となります。

OKIは、ディープラーニングモデルの演算数を削減して軽量化する技術「PCAS」を組み合わせ、演算負荷低減と演算数削減の両方の効果を得る技術の開発に取り組み、エッジ領域での高精細な画像認識、さらには工場のインフラ管理や機器の異常検知など、演算リソースの限られたデバイスでのAI実装を目指します。

出典:PR TIMES

業務の課題解決に繋がる最新DX・情報をお届けいたします。

メールマガジンの配信をご希望の方は、下記フォームよりご登録ください。登録無料です。

AI製品・ソリューションの掲載を

希望される企業様はこちら